챗GPT를 만든 오픈AI에서 새 AI 모델인 GPT-4o를 발표하자 많은 사람들이 11년 전에 나온 영화 '그녀(Her)'를 이야기한 것에는 분명한 이유가 있었다. 새 모델은 텍스트가 아닌 음성으로 사용자와 대화를 나누었을 뿐 아니라, 폰의 카메라를 통해 사용자와 똑같은 공간에서 보고, 듣는 존재로 등장했기 때문이다. 게다가 사람들이 사교적인 만남에서 대화 상대에 끌릴 때 주고받는 플러팅(flirting)까지 구사했다.

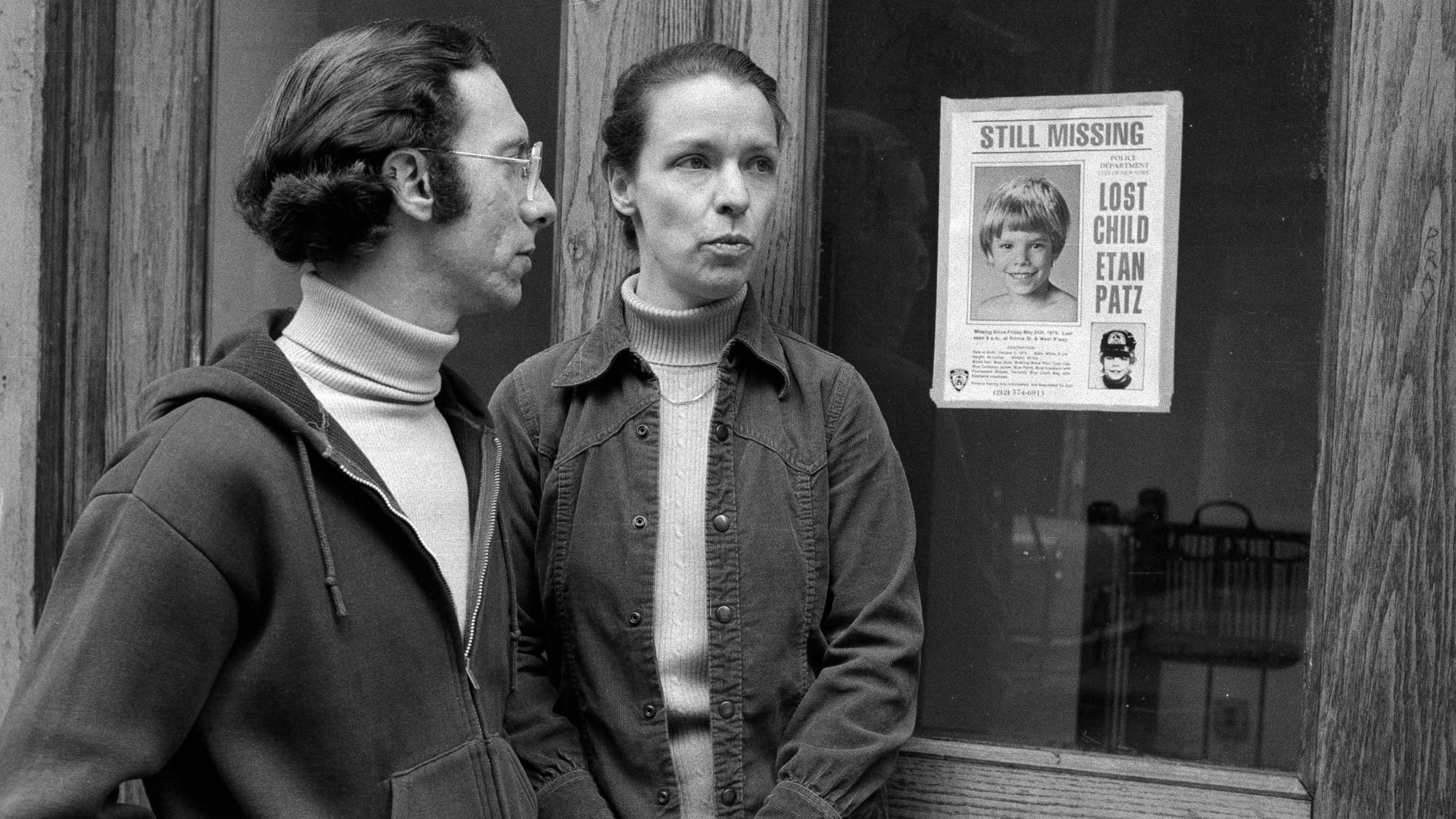

하지만 유사성은 GPT-4o에 사용된 '스카이(Sky)'라는 캐릭터가 대화에 임하는 태도만이 아니다. 목소리 자체가 스칼렛 요한슨(Scarlett Johansson)이 영화에서 연기한 목소리(사만다)와 너무나 닮았다. 먼저 데모 영상의 일부를 보자: