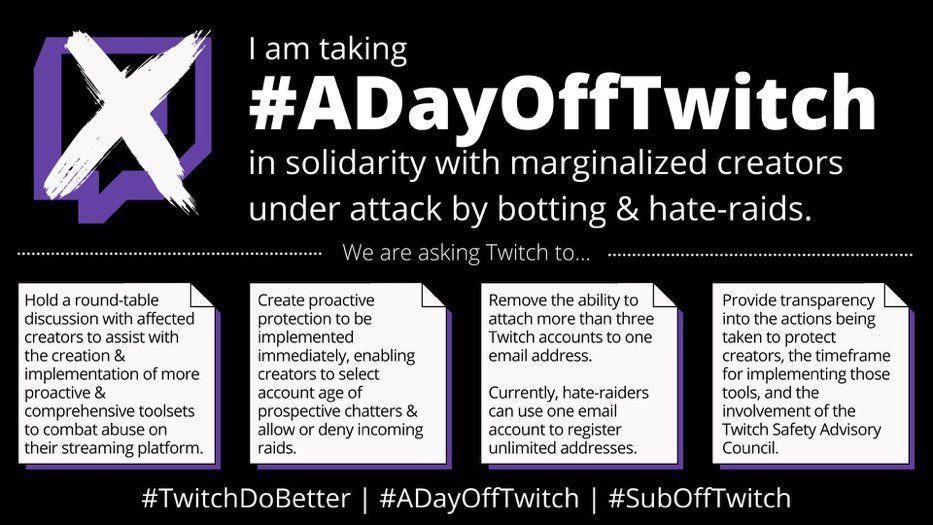

아마존이 인수한 트위치(Twitch)는 게임 방송으로 시작해서 20대 이하에서 큰 인기를 모으고 있지만 근래 들어 이 플랫폼에서 자주 나타나는 '증오 습격(hate raid)'이 문제가 되고 있다. 원래는 그날의 방송을 끝내는 스트리머(streamer)가 듣고 있던 팔로워와 시청자들에게 다른 진행자의 스트리밍을 소개, 추천해서 그리로 트래픽을 밀어주는 좋은 의도로 만들어진 기능이지만, 한국의 소셜미디어와 온라인에서 종종 보게 되는 '좌표찍기' 형태로 사용되면서 전혀 다른 방향으로 작동하게 된 거다.

그런데 이런 증오 습격은 봇(bot)을 사용한 무수한 가짜 계정들이 동원되면서 한국식 좌표찍기와는 차원이 다르게 커졌다. 그리고 대개 그렇듯 이런 공격의 대상은 소수자 집단이고, 트위치의 경우 성 소수자 스트리머들이 집중적인 공격을 받고 있다고 한다. 이 문제를 지적한 유명 스트리머/유튜버인 데븐 내쉬는 트위치가 이 문제를 해결하지 못하는 이유를 이렇게 설명한다. "가짜 계정을 손쉽게 만들지 못하도록 절차를 복잡하게 하면 되겠지만, 그런 장치는 가입자의 증가를 늦추게 된다." 그의 경험에 따르면 가입 절차에 한 페이지가 추가될 때마다 잠재 가입자의 30%가 포기하고 떨어져 나간다고 한다. 많은 사이트와 서비스의 빠른 가입자 증가 뒤에는 (가령 소셜 로그인처럼) 과거와 달리 손쉬운 가입 방법이 존재한다.