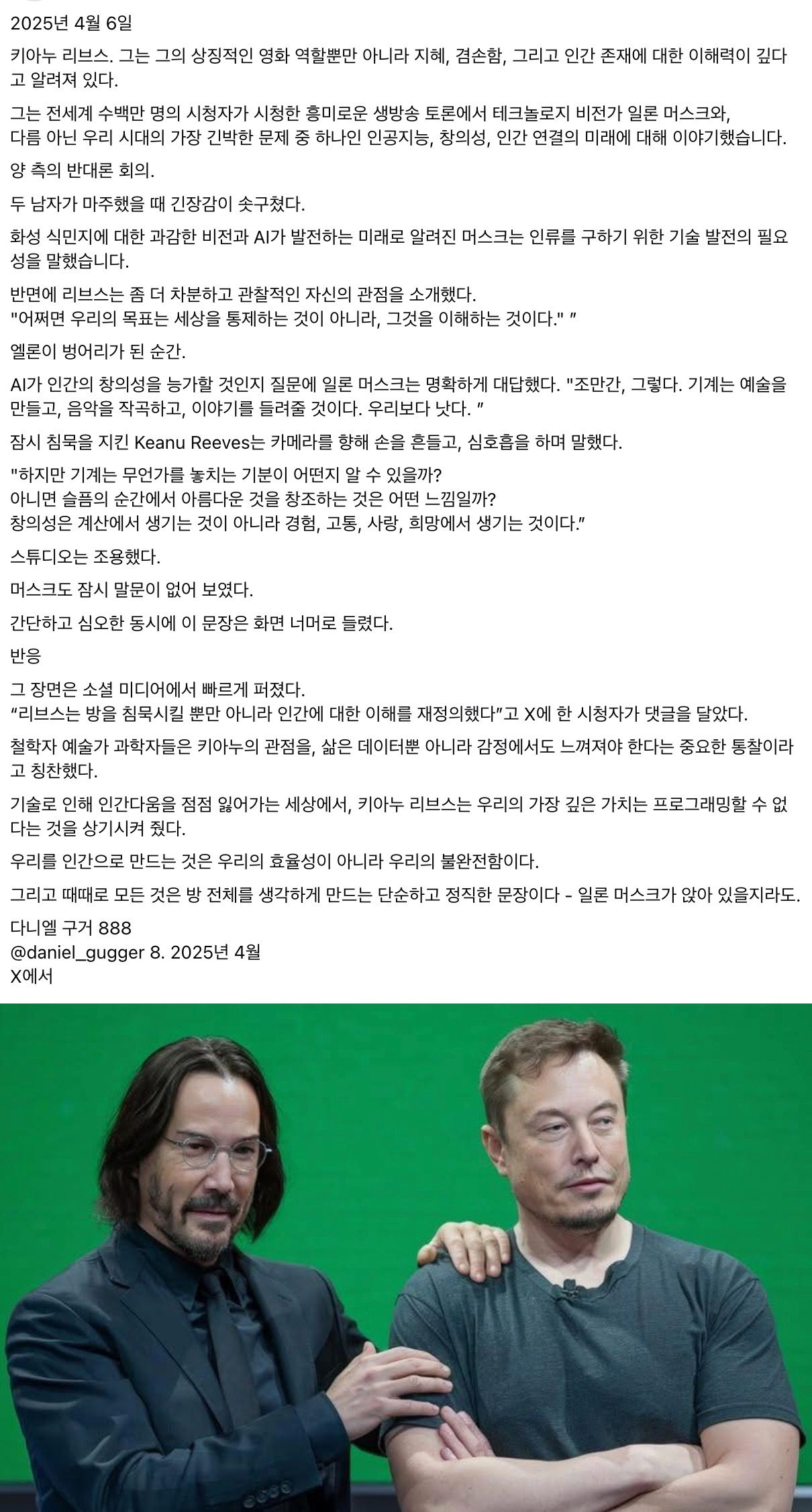

며칠 전부터 온라인에서 큰 화제가 된 포스팅이 있다. 많은 사람들이 페이스북이나 X에서 공유 버튼을 눌렀고, 좀 더 성의 있는(?) 사람들은 사진과 텍스트를 따로 복사해서 붙여 자신의 포스팅으로 공유했다. (아래 사진) 결론부터 이야기하면 이 텍스트와 사진은 모두 가짜다.

소셜미디어에서 허위 정보, 가짜뉴스를 만나는 건 일상적인 일이지만, 이 케이스는 유독 눈에 띈다. 우선 너무나 많은 사람들이 속아서 공유했기 때문이고, 더 흥미로운 건 평소 허위 정보에 잘 속지 않는 사람들도 이를 사실로 생각했기 때문이다.

출처: Facebook